一、背景

Hadoop的集群使用也有些时候了,不过都是小集群的使用(数量小于30台)。在这个过程中不断的进行着配置调优的操作。最早的时候,在网上也没有找到一些合适的配置调优方法,于是,我在这里列举一些基本的调优配置,以供参考。最后,还有一个我自己的测试环境的配置说明,也可以参看一下。

二、环境和配置

1. 版本和环境

Ø Hadoop版本:apache发布的0.21

Ø 操作系统:Linux

Ø JDK:1.6

Ø 网络环境为千兆网络

2. hdfs-site.xml配置文件

Ø dfs.block.size

这个是块大小的设置,也就是说文件按照多大的size来切分块。一般来说,块的大小也决定了你map的数量。举个例子:我现在有一个1T的文件,如果我的块size设置是默认的64M,那么在HDFS上产生的块将有1024000/64=16000块。

如果我们以TextInputFormat来处理该1T的文件,那么将会产生16000个map来处理。这样的多的map明显是不合理的。所以,如果我们将block的size设置成512M,那么,将1T的文件作为输入文件,将产生2000个map,计算的时候效率将提升不少。

因此,block size的大小是需要根据输入文件的大小以及计算是产生的map来综合考量的。一般来说,文件大,集群数量少,还是建议将block size设置大一些的好。

Ø dfs.replication

复制数量的设置,不能为0。这个名字说实话很迷惑人,最开始的时候我以为就是备份数量,后来才发现,原来就是存放数据文件的份数。

设置为1,就是在集群中存一份。如果设置为2,即做一份备份,也就是说数据在集群中有2份。还是以1T的数据为例,如果设置1,集群中就存在1T的文件,如果设置为2,那么集群占用空间为2T。

当然,这个备份还有个基于机架感知的备份机制(本地存放、同机架存放、异机架存放)如果不配置机架,默认都在一个机架上,之所以做机架感知的备份就是为了做到异地容灾。因为我现在的集群都在一个机房,就是做了机架配置,也不能做异地容灾。要是机房断电,谁也不能容灾谁。但是如果你的集群分别存放在2个机房,还是可以考虑做机架配置,然后将备份数量设置为3。

备份数量有利有弊,备份数量多,节点挂个几个没影响,数据依然完整。但是你的冗余数据会增加。如果只设置为1,那就是节点一旦有挂掉的,就是block miss。一般来说,测试情况下建议设置为1,如果实际使用,所有机器都在一个机房,建议配置为2,如果集群分布在不同机房,还是试试配置为3吧。

3. mapred-site.xml配置文件

Ø mapred.tasktracker.map.tasks.maximum和mapred.tasktracker.reduce.tasks.maximum

这个2个参数分别是用来设置的map和reduce的并发数量。实际作用的就是控制同时运行的task的数量。这2个参数实际上在配置的时候是需要结合计算节点的硬件配置以及任务调度模式来配置的。

举个例子吧。我现在有5台机器,1台master,4太slave,配置都是2个4核CPU,8G内存,1T硬盘。我配置任务调度模式是默认的FIFO模式。在这样的模式下,我配置并发map为6,并发的reduce为2。 其实这样配置不难看出,map和reduce的并发数就等于CPU的总核数。

前段时间看到网上有篇文章说map和reduce的并发数应该设置为相同。最后我考虑了一下,如果使用fair的调度模式,设置成相同,应该是可以的,但是如果是FIFO模式,我个人认为在map或是reduce阶段,CPU的核数没有得到充分的利用,有些可惜,所以,FIFO模式下,还是尽量配置的map并发数量多于redcue并发数量。

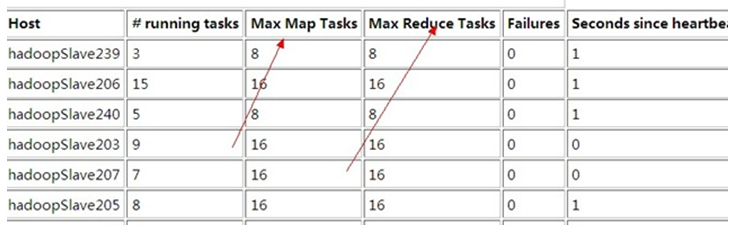

因此,我说这个参数的配置不仅仅要考虑硬件配置,还需要考虑到Job的调度模式。需要说明的是,这个配置参数不同的节点可以配置不同。适用于硬件异构的集群。见下图:

Ø mapred.child.java.opts

这个参数是配置每个map或reduce使用的内存数量。默认的是200M。对于这个参数,我个人认为,如果内存是8G,CPU有8个核,那么就设置成1G就可以了。实际上,在map和reduce的过程中对内存的消耗并不大,但是如果配置的太小,则有可能出现”无可分配内存”的错误。所以,对于这个配置我总结了一个简单的公式:map/reduce的并发数量(总和不大于CPU核数)×mapred.child.java.opts < 该节点机器的总内存。当然也可以等于,不过有点风险而已。

Ø mapred.reduce.tasks

设置reduce的数量。一般来说在job里面都会通过conf来设置reduce的数量,不采用这个参数。至于reduce的数量,可以根据自己的reduce业务逻辑复杂度以及输出的数据量来调整。

4. core-sit.xml配置文件

Ø webinterface.private.actions

这个参数实际上就是为了方便测试用。允许在web页面上对任务设置优先级以及kill任务。需要注意的是,kill任务是个缓慢的过程,它需要杀掉所有的任务task然后才是任务结束。如果task数量多,可能有点慢,需要一些耐心等待。

三、总结

需要说明一下,配置文件的加载顺序是:先加载默认的配置项(看看default文件就知道默认配置项了),然后加载site文件里的配置项,最后加载MR代码里的配置项。所以,个性化的配置还是放在MR代码中通过cong.set方法来设置比较合适。

其他的还有一些配置,例如task心跳响应延迟时间(默认10分钟)、task失败尝试次数等等,这个有兴趣可以改改试下。对于集群,hadoop还自带一些测试的工具,例如集群的I/O测试,这个是最常用的。用法一般为hadoop jar hadoop-mapred-test-0.21.0.jar TestDFSIO -write -nrFiles 10 -fileSize 1000。执行完成之后会在同级目录下有TestDFSIO_results.log文件,查看就行。

四、附件

这个是我的测试环境,大家可以参考一下:

Ø 数据量:1.3T文本文件,约31亿条数据,每条数据70个字段。

Ø 业务:过滤所有数据,然后去重排序。

Ø 硬件:集群共5台设备(8G内存、2个4核CPU、1T硬盘、千兆网卡,千兆交换机器)

Ø 软件配置见下表:

|

字段 |

值 |

|

blocksize |

512M |

|

调度模式 |

FIFO(就一个任务) |

|

mapred.child.java.opts |

1024M |

|

mapred.tasktracker.map.tasks.maximum |

6 |

|

mapred.tasktracker.reduce.tasks.maximum |

2 |

|

Reduce数量 |

200 |

|

dfs.replication |

1(硬盘空间不够,就设置了1) |

Ø 任务耗时:3小时30分钟左右。