一、背景

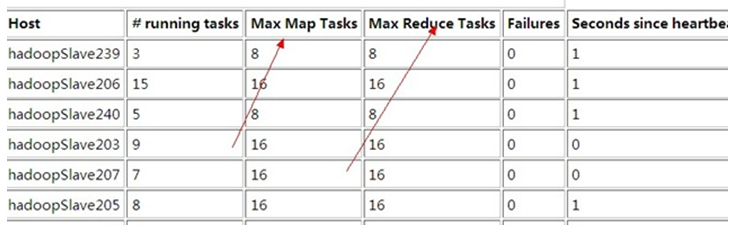

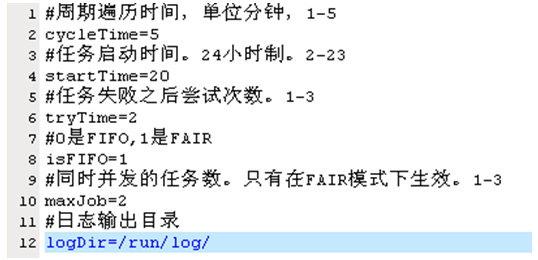

Hadoop的集群使用也有些时候了,不过都是小集群的使用(数量小于30台)。在这个过程中不断的进行着配置调优的操作。最早的时候,在网上也没有找到一些合适的配置调优方法,于是,我在这里列举一些基本的调优配置,以供参考。最后,还有一个我自己的测试环境的配置说明,也可以参看一下。

二、环境和配置

1. 版本和环境

Ø Hadoop版本:apache发布的0.21

Ø 操作系统:Linux

Ø JDK:1.6

Ø 网络环境为千兆网...

阅读全文

在 MongoDB 上使用 Map/Reduce 进行并行 "统计" 很容易。

db.runCommand(

{

mapreduce : <collection>,

map : <mapfunction>,

reduce : <reducefunction>

[, query : <query filter object>]

[, sort : <sort the query. useful optimization>] for

[, limit : <number of objects to from collection>] return

[, out : <output-collection name&g...

阅读全文

Hadoop FS Shell命令大全

调用文件系统(FS)Shell命令应使用 bin/hadoop fs 的形式。 所有的的FS shell命令使用URI路径作为参数。URI格式是scheme://authority/path。对HDFS文件系统,scheme是hdfs,对本地文件系统,scheme是file。其中scheme和authority参数都是可选的,如果未加指定,就会使用配置中指定的默认scheme。一个HDFS文件或目录比如/parent/child可以表示成hdfs://namenode:namenodeport/parent/child,或者更简单...

阅读全文

在当下的云计算领域,数据的存储和处理模型作为整体的基石,所以想在云计算中不迷失方向,摸着这些基石,按石索骥。

Hadoop本身内置的几个重要基石:

HDFS:提供分布式文件系统:提供系统文件级别的抽象和封装,主从模式的架构,API接口,对应的文件的管理和监控体系。

MapReduce:构建在HDFS之上,当然也可以推广到更加广泛的分布式存储平台上的并行计算模型,以Key-Value作为数据模型,通过Mapper,Reducer阶段,以及内置的Sh...

阅读全文

1.配置NameNode

[hadoop@node14 conf]$ cat core-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://node14:9000</value>

</property>

</configuration>

阅读全文

性能测试小结: 测试环境: 机器:1 client 5 regin server 1 master 3 zookeeper 配置:8 core超到16 /24G内存,region server分配了4G heap /单seta磁盘,raid10后500GB 系统:Red Hat Enterprise Linux Server release 5.4 版本:hadoop-0.20.2+737 / hbase-0.90.1 / Java HotSpot(TM) 64-Bit Server VM (build 17.0-b16, mixed mode) htable假设:row key = 200 Byte;row value=1k Byte;1 family 1 column

前期主要测试...

阅读全文

一、背景

前些时候写了一篇这样的文档,由于当时的时间比较紧,且有些细节内容不太好细说,于是写的比较粗。之后也有些朋友发邮件给我,问我要详细的过程以及管理方式。于是,今天就像把这个内容细化,写在这里,供大家参考。

二、环境简述

Ø 操作系统Linux、JDK1.6

Ø Hadoop 0.20.2

Ø 开发工具选择eclipse 3.3.2(可配合使用hadoop的插件)

三、需求

首先还是要说一下需求,为什么要用hadoop的API来对Job进行管理。对此...

阅读全文

好多的教程是通过eclipse提交的任务。当然这只是玩玩。

如果在ubuntu-server集群中这当然行不通。因此jobtracker通过命令行的形式提交任务看起来比较实际。

比如

file1.txt:

2012-3-1 a

2012-3-2 b

2012-3-3 c

2012-3-4 d

2012-3-5 a

2012-3-6 b

2012-3-7 c

2012-3-3 c

file2.txt:

2012-3-1 b

2012-3-2 a

2012-3-3 b

2012-3-4 d

2012-3-5 a

2012-3-6 c

2012-3-7 d

2012-3-3 c

任务是将file1.txt+file2.txt并实现去重...

阅读全文

原文地址:http://blog.csdn.net/dajuezhao/article/details/6797015

一、背景

1、最近在做hadoop的性能测试,采用了自带的Terasort的方式,但是在运行的过程中发现如果数据量过大,对硬盘I/O需求不小(通过Ganglia监控发现),因此,打算找找看是否有合适的配置来解决这样一类的问题,所以才有了这篇记录的文档。

2、在做修改之前,当然必须确认slave的多块硬盘没有做任何形式的raid。

二、修改配置

1、hdfs-site.xml...

阅读全文

导读:众所周知,2006年Google公布了自己的BigTable论文,作为Google继GFS和MapReduce两项创新之后的又一项创新,其在设计用来针对海量数据处理情形下的管理结构型数据方面具有着巨大的技术优势。而Hypertable和HBase是最知名的两款基于BigTable为蓝本设计的数据库,他们的不同之处在于Hypertable基于C++实现,而HBase则基于Java。两种数据库的性能也一直是人们争论的热点话题。在最近的一次性能测试中Hypertable在吞吐率测试...

阅读全文