人工神经网络就是一种模仿生物神经网络行为特征,进行分布式并行信息处理的算法数学模型,但是并不需要精确的数学模型加以描述。目前我们使用的各种数学工具都是以精确的数学模型做描述的,但是很多情况下是很难得到一个精确的数学描述。人工神经网络就是模拟人脑神经网络,这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的。使得具有学习、联想记忆、综合等能力,比如语音、图像的识别、理解,知识的处理,组合优化计算等一系列本质上非计算的问题。

从整体框架下理解人工神经网络,它也就包括三个主要部分:神经元模型,网络模型以及网络的学习规则。因此不同神经元模型、网络模型、学习规则相互组合就产生了各种各样人工神经网络,组合出来的神经网络也就各具特色。但是他们也会具有一些共性,也就是因为这些网络之间要么神经元相似,要么网络拓扑模型相似,要么学习规则相似。所以只要把这三个部分整体把握起来,人工神经网络也就很容易抓住要点。

先说神经元模型,所有神经元的基础都是1943年McCulloch和Pitts提出的MP模型,然后各有自己的特点。他们之间的区别主要在两个方面:一、输入和权值的运算关系,像感知机、ADLINE、BP网络都是输入与权值的累加,而径向基函数神经网络则不是;二、传递函数的不同,如有阶跃型函数、符号函数、线性函数、饱和线性函数、对数S型函数、双曲正切S型函数等等,这才使得神经网络更加丰富多彩。也就是因为传递函数的不同,也导致了一些神经元的网络拓扑结构受到了限制,如原始的感知机中传递函数是阶跃型函数,它的输出是1或0的二值函数,所以不能作为进一步网络的输入,因此原始的感知机只是单层网络。

神经网络的网络拓扑结构大体有前向型、反馈型、自组织竞争型和随机型网络等拓扑结构(出发点不同网络结构的分法也不一样)。前向型的人工神经网络有学习、分类等功能,反馈型的人工神经网络有联想记忆、优化计算等功能,自组织竞争型的人工神经网络有聚类、搜索、自组织、自学习等功能。我们熟知的感知机,ADLINE,有监督Hebb学习,多层前向BP网络等网络都隶属于前向网络。网络的层数都各有不同,对于多层网络,明显就要比层数少得网络要复杂,但是功能将更加也更加先进。举个反例,就比如单层的感知器只有简单的分类作用,并且还要是线性可分的任务才能得以解决。

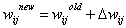

对于学习规则,这个也非常重要,他直接关系到神经网络的功能和学习速率,就和人一样,有的人学习的比较快,大家都说他聪明,而对于那些学习知识很慢的人大家会觉得比较笨,这点只是也要理解这么长时间;有的人擅长形象思维,绘画、舞蹈、艺术比较好,而有的人逻辑思维好,于是他可能会在自然科学方面有所成就,这也就和神经网络的主要作用方面相似,每种学习算法都有自己独特的特性表现在整体的神经网络上。几乎所有神经网络的学习规则都可以看作Hebb学习规则的变形,都是以Hebb规则为基础的。Hebb规则假定:当两个细胞同时兴奋时,它们之间的连接强度应该增强。这条规则与“条件反射”学说一致,后来得到了神经细胞学说的证实。 ,各种学习规则都集中体现在权值的变动

,各种学习规则都集中体现在权值的变动 项上了,有的学习规则是基于差异,有的基于竞争的,有的基于相关性,等等。根据学习规则需不需要训练样本有期望输出,我们也就可以把神经网络分为了有导师(有监督)、无导师(无监督)的学习,这也和我们生活中的学习很相像。就如我们上课读书学习时,老师让我们起来回答问题,然后我们给出了一个自己的答案,也不知道到底对不对,但是老师会说“恩,你说的对”或者“你答错了”,这就明确给了你一个期望输出。如果你错了,下一步就还要继续学习了。

项上了,有的学习规则是基于差异,有的基于竞争的,有的基于相关性,等等。根据学习规则需不需要训练样本有期望输出,我们也就可以把神经网络分为了有导师(有监督)、无导师(无监督)的学习,这也和我们生活中的学习很相像。就如我们上课读书学习时,老师让我们起来回答问题,然后我们给出了一个自己的答案,也不知道到底对不对,但是老师会说“恩,你说的对”或者“你答错了”,这就明确给了你一个期望输出。如果你错了,下一步就还要继续学习了。

以上把神经元模型、网络模型以及学习规则讲述完毕,所有的人工神经网络也就基本上都被概括了。他们三个相互排列组合就产生了各种各样人工神经网络,组合出来的神经网络也就各具特色。所以只要把这三个部分整体把握起来,人工神经网络也就很容易抓住要点了,这就是我对人工神经网络的理解和认识。

原创作品,转载请注明原作者及地址!

by 飞鸿惊雪